Przykładowe ujęcie z wykorzystaniem techniki pseudo-HDR. Ten sam obraz w wyższej rozdzielczości może być spójrz na mnie na 500px.

HDR (High Dynamic Range) to wysoki zakres dynamiczny. Zazwyczaj fotografowie rozumieją „HDR” jako „zdjęcia HDR” lub „zdjęcia HDR” wykonane przy użyciu technologii braketingu ekspozycji. Widelec Expo (widelec ekspozycja lub nawiasy ekspozycja) polega na uzyskaniu tego samego obrazu z różnymi ekspozycjami, a następnie połączeniu ich w jedno zdjęcie o rozszerzonym zakresie dynamicznym. Można obejrzeć wiele przykładów „klasycznych zdjęć HDR” tutaj.

Ale jest dość łatwy sposób na zdobycie Wynik podobny do HDR z tylko jednego zdjęcia RAW. Zasób danych w formacie RAW często wystarcza do znacznej korekty cieni i świateł. Istotą metody pseudo-HDR jest „opracowanie” obrazu RAW z różnymi korektami ekspozycja, a następnie zebrać opracowane obrazy w jeden, który będzie miał rozszerzony zakres dynamiczny.

czasami tego używam technika pseudo-HDR:

- Z jednego pliku RAW robię 11 poprawionych plików JPEG ekspozycja -5 -4 -3 -2 -1 0 +1 +2 +3 +4 +5. Jeśli zakres dynamiczny używanej kamery jest bardzo niski, na przykład Nikon D40 to jest w rejonie 9 kroków, wtedy używam zestawu poprawek ekspozycja -2 -1.66 – 1.33 -1 -0.66 -0.33 0 +0.33 +0.66 + 1 +1.33 +1.66 +2. Dla każdej kamery możesz wybrać swój własny optymalny zestaw przesunięć ekspozycja. Możesz użyć mniej lub więcej przesunięć, ale pożądane jest, aby zestaw symetryczny z poprawkami plus i minus.

- Łączę powstałe pliki JPEG w jeden obraz pseudo-HDR. Najczęściej używam dość prostej wtyczki Google Nik Collection HDR EFEX PRO 2. Teraz pakiet wtyczek Nik Collection jest płatny (DXO kupiło go od Google), ale kiedyś był dystrybuowany za darmo!. Wtyczka współpracuje z Adobe Photoshop i Adobe Lightroom. Możesz także łączyć pliki innymi metodami, programami i wtyczkami. Kto to robi - opisz swoje metody i programy w komentarzach.

Przykład

Najpierw biorę oryginalny plik RAW i konwertuję go „tak jak jest”:

Dalej robię nawiasy ekspozycja w krokach co 1/2 stopnia, pięć kroków na minus i pięć kroków na plus. Zapisuję każdy krok jako plik JPEG i kończę z 11 zdjęciami.

Bracketing ekspozycja w krokach co 1/2 stopnia (11 zdjęć)

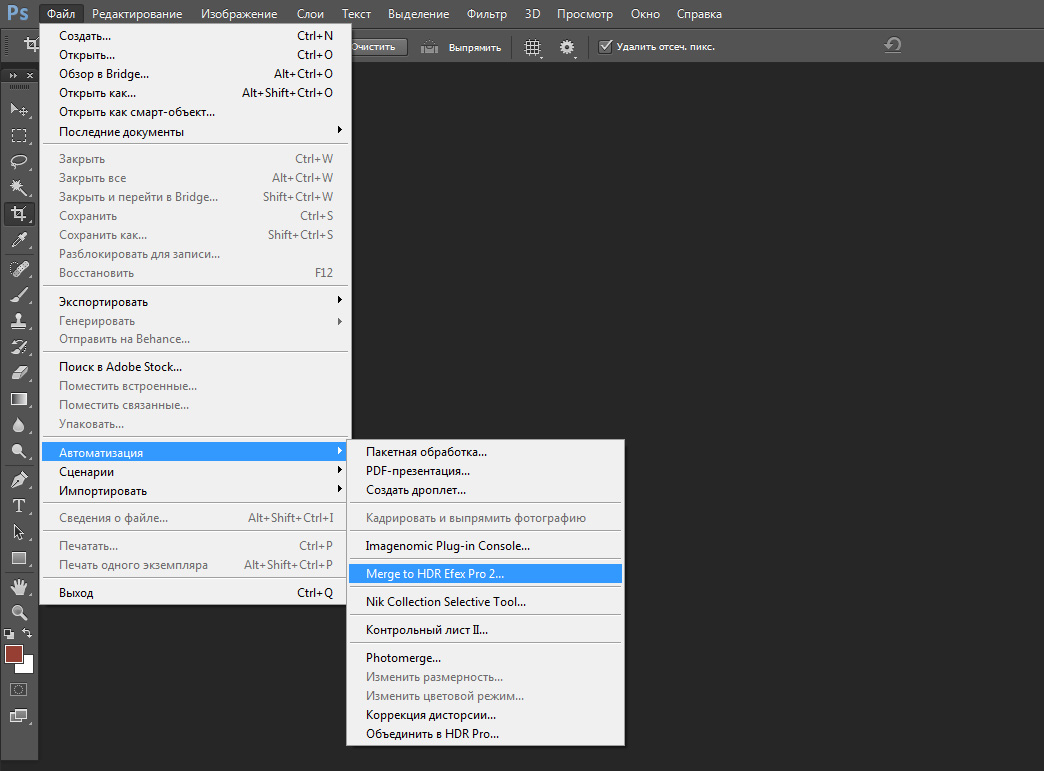

Następnie przesyłam zdjęcia do Nik Collection HDR EFEX PRO 2, wywołując odpowiednie menu z automatyzacji w Adobe Photoshop:

Następnie korzystam z końcówek Nik Collection HDR EFEX PRO 2 i osiągam pożądany rezultat:

W rezultacie otrzymuję wynik, którego potrzebuję:

Wynik pracy. Linia horyzontu została celowo wyśrodkowana, aby podkreślić symetryczne odbicie chmur w wodzie.

Podobną metodę można czasem bardzo dobrze zastosować nie tylko do pejzaży, fotografii architektonicznej, ale także do portretu, w którym nie jest to takie łatwe do wykonania nawiasy ekspozycja bez przesuwania modelu w kadrze, przykłady:

W nowoczesnych aparatach o bardzo szerokim zakresie dynamicznym, takich jak Nikon D850, sony a7r iv itp. ta metoda może dać bardzo dobre rezultaty. Jednak w przypadku nowoczesnych aparatów zwykła korekcja cieni, półcieni i świateł daje przyzwoity pseudo-HDR bez konieczności stosowania braketingu ekspozycji.

Komentarze do tego posta nie wymagają rejestracji. Każdy może zostawić komentarz. Wiele różnych urządzeń fotograficznych można znaleźć na AliExpress.

Przygotowany materiał Arkady Shapoval. Szkolenia/Konsultacje | youtube | Facebook | Instagram | Twitter | Telegram

IMHO, to prawie bez sensu przy dzisiejszym rozwoju edytorów, teraz pozwalają zrobić to samo, po prostu przeciągając suwaki - to samo DxO ma samouczek na ten temat https://www.dxo.com/project/creating-an-hdr-effect-from-a-single-raw-image/ . Ponadto Sony ma wbudowany w aparat optymalizator D-Range, który działa dokładnie tak samo, o ile rozumiem. Ale jeśli masz możliwość porównania dwóch podejść (z jednego pliku lub tworzenia „nawiasów”), ciekawie byłoby popatrzeć.

Teoretycznie, korygując zakresy w RAW można oczywiście osiągnąć jeszcze lepszy efekt, zwłaszcza jeśli również korygujesz zakresy do zadania lub robisz to w krzywych.Ale metoda opisana powyżej jest godna uwagi przede wszystkim dlatego, że może być zautomatyzowane przez skrypt i dają średnio takie same dobre wyniki, jak żmudna praca z suwakami i zakresami.

prawdopodobnie warto było opublikować przynajmniej jeden surowy plik, aby móc się nim pobawić i porównać z wynikami

Nie ma problemu, tutaj

tak, wielkie dzięki!

Jest jeszcze jeden niuans, który myli.

czujniki z dużym DD zwykle nie lubią prześwietlenia i mają duży margines przyciągania cienia. więc scena z naprawdę wysokim DD jest zwykle nagrywana z dużą ujemną kompensacją ekspozycji, aby oszczędzać światło.

W związku z tym generowanie symetrycznie poprawionego jpega z takiego pliku nie wydaje się praktyczną radą.

To są niuanse, o których wspomniałem. Na przykład w S5 pro światła rozciągają się idealnie. Metodę można dostosować do konkretnego aparatu.

>zazwyczaj nie przepadam za prześwietleniem i mam duży margines przeciągania cieni

Najwyraźniej zależy to od aparatu: np. reguła ETTR (ekspozycja w prawo) pomaga mi całkiem dobrze na (stosunkowo starych) korpusach Fuji i Pentax: zarówno niebo jest na swoim miejscu, jak i cienie bez szumu w przypadku pejzaży.

Przy 20-24 MP Sony też działa całkiem nieźle. I odwrotnie – na antycznym Olympusie, jeśli mam wybierać, to wolę niedoświetlać.

Myślę, że całkiem realistyczne jest poznanie limitu dla swojego aparatu, gdy informacje w cieniach / światłach są bezpowrotnie wymazane.

PS chociaż - w przypadku niektórych soczewek - niedoświetlenie lub prześwietlenie = ramka do kosza. To prawda, wtedy bracketing ratuje :-)

Przekręciłem przykład – to kompletnie niezrozumiałe, po co tyle brać.

po prostu podnosisz go w surowych cieniach i otrzymujesz dokładnie ten sam „HDR”.

a w kadrze jest dużo wybitych świateł, co nieco nie pasuje do idei uzyskania HDR)

Słuchaj, nie tylko wskazałem „Pseudo-HDR” w tytule notatki.

Jest napisane

Jednak w przypadku nowoczesnych aparatów zwykła korekcja cieni, półcieni i świateł daje przyzwoity pseudo-HDR bez konieczności stosowania braketingu ekspozycji.

hdr ze zmienną aperturą - widać, że cienie poza głębią ostrości są w „mgiełce”, chociaż zmarszczki na wodzie i odbicie są wyraźne. HDR +0-1 stop w trybie stałej migawki i ISO, zmienna przysłona. Dzięki zmieniającej się głębi ostrości (0 na hiperfokalnej) udało się osiągnąć naturalną transmisję obrazu (wystarczy skleić to w HDR).

Ciekawa aplikacja

I naprawdę ciekawe ujęcie. Dzięki za udostępnienie

Dlaczego jest to konieczne? hdr ze zmienną przysłoną?

W jakim trybie kręcisz w HDR?

Oto mój przykład hdr bez zmiany apertury.

Cóż, ekspozycja zależy od dwóch parametrów - przysłony i czasu otwarcia migawki. ISO formalnie nie wpływa na ekspozycję, ilość światła pozostaje taka sama, zmienia się wzmocnienie. Tak więc w przypadku przedziału ekspozycji zwykle bawi się czasem otwarcia migawki, zapewniając mu niedoświetlenie i prześwietlenie. Ale nic nie stoi na przeszkodzie, abyś robił braketing przysłony w dokładnie tych samych celach. Ciekawy pomysł, będę musiał spróbować i zobaczyć, co się stanie. W efekcie niedoświetlony obraz będzie ostrzejszy ze względu na większą głębię ostrości, podczas gdy prześwietlony będzie odwrotnie.

Dlaczego jest to konieczne, jeśli w aparacie jest HDR?

Który?

Cóż, mam asusa 3 lata temu. on ma )

Od kiedy Asus zaczął robić aparaty fotograficzne? o_o

odkąd aparaty trafiły do smartfonów

Mam też Olympusa e-m10, ale go nie używam. Na pentaksie też wydawało się, że to k-5 i młodsi

na przykład na Canonie Rp jest HDR, ale to tylko dla architektury, bo. wykonuje trzy strzały.

W tym czasie modelka ma czas na ruch.

Canon D700 obsługuje tryb HDR (3 klatki).

700d

Asus nie wypuszcza aparatów. Laptopy, smartfony, pecety i monitory, zegarki i różne dodatki do nich. Komentator ma na myśli, jak rozumiem, smartfon ZenFone 6. Ma wysuwany aparat 48 mm i możliwość kręcenia HDR. To smutne, gdy ludzie nie rozróżniają aparatu fotograficznego i aparatu w smartfonie ((q

Drodzy eksperci, czy dobrze rozumiem, że ta metoda nie działa tylko z natywnym konwerterem Nikon Capture NX-D?

Pracujący. Tworzysz również nawias ekspozycji z rav z eksportem do jpeg. Następnie uszyj coś

To jest główna istota zagadnienia – o ile rozumiem, nie da się szyć Nikonem Capture NX-D. Czy możesz mi podać dostępną wersję „crosslinkera” do przetestowania metody?

Szczerze mówiąc, nie widziałem normalnego zszywacza HDR)) Zwykle nie jestem zadowolony z wyniku, może moje ręce nie są stamtąd. Jest Photomatix Pro - działa całkiem nieźle, jako wtyczka do Photoshopa i osobno.

HDR jako krzykliwe „przetwarzanie” wyszedł z mody, kiedy po raz pierwszy się nim zainteresowałem. Bardzo trudno jest uzyskać efekt natychmiastowej kompresji znajomego oku zakresu tonalnego. Tak iw zasadzie nie jest to konieczne.

Ogólnie rzecz biorąc, przetwarzanie tak naprawdę sprowadza się do odpowiedniej manipulacji tylko trzema suwakami podczas wywoływania - ekspozycja, czerń, biel. W razie potrzeby kontrast do minusa na zdjęciach z ostrym światłem lub plus do zdjęć o niskim kontraście, a następnie dostosuj czerń, biel i ekspozycję. Jeśli to wciąż za mało, możesz wypróbować cienie/podświetlenia, ale w ostateczności - to właśnie daje ten obrzydliwy efekt pseudo-HDR. Problem polega na tym, że czernie/bieli manipulują marginesami cieni i świateł, które znajdują się na obrazie 12-14-bitowym podczas próby wyświetlenia ich na monitorze 8-bitowym, podczas gdy cienie/światła działają już z resztą 8-bitową, z maski, pozostawiając tę paskudną granicę na granicach przejść. Oto te typowe krajobrazy, kiedy próbują narysować odległy bardzo ciemny las za pomocą narzędzia „cienie”, a nad krawędzią drzew znajduje się pasek ograniczający obszar maski tworzonej przez rozmazany obraz.

Cóż, jeśli chcesz narysować oddzielne jasne obszary - latarnie, słońce - możesz zrobić stos kilku obrazów - z prawdziwym bracketingiem lub tak, sztucznym i osobno, z uchwytami, pokaż niezbędne elementy za pomocą maski. Apologeci za erotyczne formy niedostępnych idoli zaczną marszczyć nosy, ale umiejętna obróbka zdjęć jest czasem ważniejszym narzędziem niż najbardziej pożądany aparat z najbardziej legendarnym obiektywem.

Te suwaki działają z tym samym obrazem, więc paleta będzie taka sama. Algorytmy są stosowane inaczej, od niego i od granicy. HDR to fajna sprawa, ale programy zwykle niepoprawnie przyklejają wspornik ekspozycji, więc zapomniałem o tym biznesie – lepiej nałożyć maskę

Oryginalny obraz ma 12 lub 14 bitów, rozciągnięty do 16 bitów. Cel jest 8-bitowy. Zwykle „ogony” w światłach i cieniach są odcięte, jest kilka znaczących pikseli. Ale jeśli obraz jest bardzo kontrastowy, np. mocne światło dzienne w otwartym słońcu, ciemny klawisz lub jasny klawisz lub banalny ślub z panem młodym w ciemnym garniturze i panną młodą w śnieżnobiałej sukience (są jeszcze opcje z kolorami skóry), następnie obraz można skompresować, podciągając ogony jedną lub drugą stroną. Real HDR umożliwiłby zobrazowanie całego zakresu tonalnego, ale w przypadku braku takiej możliwości stosuje się rodzaj „mapowania tonów”. Jednocześnie jakość obrazu nie ucierpi, wręcz przeciwnie, dodajemy te szczegóły, które mogą zostać utracone.

Ale te „pseudo-HDR” to cienie/podświetlenia na sterydach, gdy ciemne i jasne piksele są wyciągane z ogonów do środka, bo nie są widoczne na krawędziach, a oko ma mniejszą czułość, a krzywa gamma daje maksimum kontrast w centrum. W tym przypadku nie wszystkie piksele są rozciągnięte, ale wzdłuż maski, która jest rozmytym obrazem. W końcu coś musi pozostać białe, a coś czarnego, inaczej obraz będzie niepełny tonalnie. Ale wygląda dość vyrviglazno i głupio. Widziałem kilkanaście obrazów - widziałem wszystko.

Tak, wszystko jasne, ok, chodźmy)

Czasami musiałem nakładać kombinację plików o różnym przetwarzaniu z tego samego RAW-a. Ale nie użyłem aplikacji do zdjęć HDR, ale ręcznie załadowałem pliki z różnym przetwarzaniem na warstwy w edytorze GIMP, a następnie wymazałem obszary na różnych warstwach i uzyskałem połączony obraz. Oto przykładowe zdjęcie (aparat Panasonic Lumix DMC-G3, 2017, teraz chyba zrobiłbym lepiej): (https://ibb.co/NC8JqDp) Z dodatkowych warstw dodałem twarze, a także tło - niebo i budynki. Oryginalny JPG z aparatu :(https://ibb.co/7K1kM2w)

Próbowałem też wcześniej opanować tradycyjny HDR, używając wtyczki do GIMP-a. Wyniki nie były zbyt dobre, ale same oryginalne zdjęcia też nie były zbyt dobre. Teraz znalazłem kolejną wtyczkę do GIMP-a, podobną do tych, których używałem wcześniej. Ale dzięki temu wyniki są znacznie lepsze, a teraz moje oryginalne zdjęcia są również lepsze. Tej jesieni właśnie zrobiłam zdjęcia budynków w Kijowie z wieczornymi iluminacjami na konkurs „Wiki do kochających przypomnień”. Okazuje się na przykład tak:https://ibb.co/LhQMXRV), oryginalny JPG z aparatu :(https://ibb.co/Bnj1jfQ)

EXIF pokazuje, że to nie jest G3, ale G80. Tak i pojawił się w 2011, a nie 2017.

Mam nowy aparat Panasonic Lumix DMC-G80, na nim zostały zrobione zdjęcia HDR. I pierwsze zdjęcia na G3, potem je miałem.

Wrzuciłem ponownie plik z pierwszego przykładu - JPG z aparatu (https://ibb.co/L5ttCcL), najpierw przesłałem zły plik.

Na portretach pseudo-HDR jest często zbędny, ale tak, to świetna technika, używam jej cały czas.

Używam Lightrooma. Załadowane wtyczki, a wśród nich przetwarzanie w HDR. Z pliku RAW otrzymujesz ostrzejsze, bardziej soczyste zdjęcia. Czy to też pseudo-HDR? A może to coś innego?

Tak, + - to samo - rozszerzenie dd z jednego pliku RAW