Un día me pregunté: '¿Por qué los archivos RAW de mi cámara Nikon D700 pesa tan poco?'. Mientras buscaba una respuesta, encontré información muy interesante.

Sobre el arte de píxeles

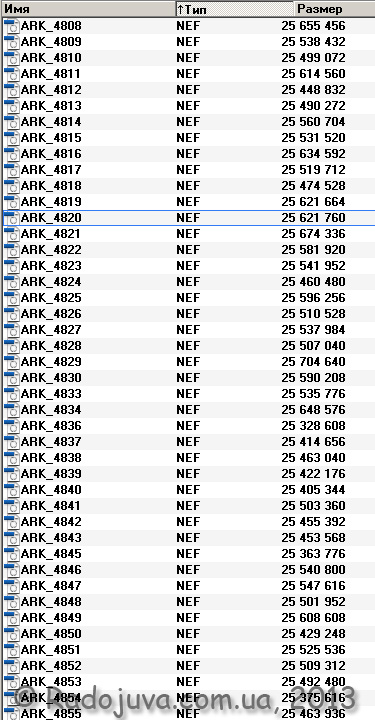

Por lo tanto, cuando disparo, a veces uso el formato de archivo RAW (Nikon lo llama NEF, formato electrónico de Nikon, el formato de archivo electrónico de Nikon). Archivos RAW de Nikon tener ciertas configuraciones, normalmente uso una profundidad de color de 14 bits con compresión sin pérdidas o sin compresión. En general, los archivos NEF sin comprimir de 14 bits pesan alrededor de 24.4 MB. En la imagen de abajo, he mostrado los tamaños de mis archivos en bytes.

Tamaños de archivo NEF en mi cámara Nikon D700

Como puede ver, los archivos son casi del mismo tamaño. Tomemos, por ejemplo, el archivo ARK-4820.NEF, su peso es de 25 bytes o 621 MB. Bytes a Megabytes se traducen de manera muy simple:

25 / 624 = 760

Quiero llamar su atención sobre el hecho de que el diferente peso de los archivos RAW (NEF) se debe al hecho de que no solo contienen información 'sin procesar' útil, sino también una pequeña imagen de vista previa, así como EXIF módulo de datos La imagen de vista previa se utiliza para ver rápidamente la imagen en el monitor de la cámara. La cámara no requiere descargar un archivo pesado de 25 MB durante la visualización rápida, sino que simplemente saca una imagen en miniatura y la muestra en su pantalla. Lo más probable es que estas imágenes estén codificadas con JPEG, y el algoritmo JPEG es muy flexible y requiere una cantidad diferente de información para el almacenamiento de cada miniatura individual.

La profundidad de color de 14 bits significa que cada uno de los tres sombras codificado con 14 bits de memoria. Por ejemplo, cuando hace clic en el botón 'signo de interrogación' en el elemento de menú correspondiente de la cámara Nikon D700 Puedes leer lo siguiente:

Las imágenes NEF (RAW) se graban con una profundidad de color de 14 bits (16384 niveles). Al mismo tiempo, los archivos son más grandes y una reproducción más precisa de los tonos.

El color se forma mezclando tres tonos básicos: rojo R (Rojo), azul B (Azul), verde G (Verde). Así, si utilizamos una profundidad de color de 14 bits, podemos obtener cualquiera de los 4 colores. (cualquiera de los cuatro mil trescientos noventa y ocho mil cuarenta y seis millones quinientos once mil ciento cuatro colores).

Es fácil de calcular: 16384 (R) * 16384 (G) * 16384 (B)

De hecho, 4 mil millones es mucho más de lo necesario para la reproducción normal del color, se utiliza una cantidad tan grande de colores para una fácil edición de imágenes. Y para codificar un 'píxel' de la imagen de esta manera, se necesitaría 42 bits de memoria:

14 bits R + 14 bits G + 14 bits B = 42 bits

Mi Nikon D700 crea imágenes de máxima calidad 4256 por 2832 píxeles, lo que da exactamente 12 052 992 píxeles (alrededor de 12 millones de píxeles, o simplemente 12 MP). Si codifica imágenes de mi Nikon D700, sin el uso de algoritmos de compresión y compresión de datos, y con una profundidad de color de 14 bits, resulta que necesitas usar 506 bits de información (225 bits/píxel por 664 píxeles). Esto es igual a 42 bytes o 12 MB de memoria.

Pregunta: ¿Por qué se calcula que se requieren alrededor de 60 MB de memoria para una imagen, pero en realidad obtengo archivos de solo 24.4 MB? El secreto radica en que el archivo RAW original no almacena píxeles 'reales', sino información sobre los subpíxeles de la matriz CMOS. Nikon D700.

En la descripción de la cámara puedes encontrar lo siguiente:

extracto de las instrucciones para la Nikon D700

Es decir, las instrucciones dicen sobre 'píxeles efectivos' y sobre el 'número total' de píxeles. El número de píxeles efectivos es muy fácil de calcular, simplemente dispare en modo JPEG L Fine y obtenga una imagen de 4256 por 2832 píxeles, que es igual a los 12 píxeles descritos anteriormente. Si redondeamos hacia arriba, obtenemos los 052 MP declarados en la instrucción. Pero, ¿qué es ese 'número total de píxeles', de los que hay casi un millón (992MP) más (12.1 MP)?

Para entender esto, basta con mostrar cómo se ve el sensor de la cámara sensible a la luz. Nikon D700.

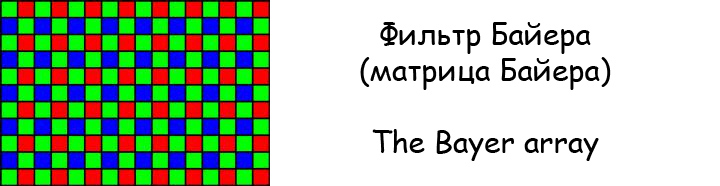

Filtro de Bayer

Si te fijas bien, la matriz de Bayer no crea ninguna imagen 'multicolor'. La matriz simplemente registra puntos verdes, rojos y azules, con el doble de puntos verdes que rojos o azules.

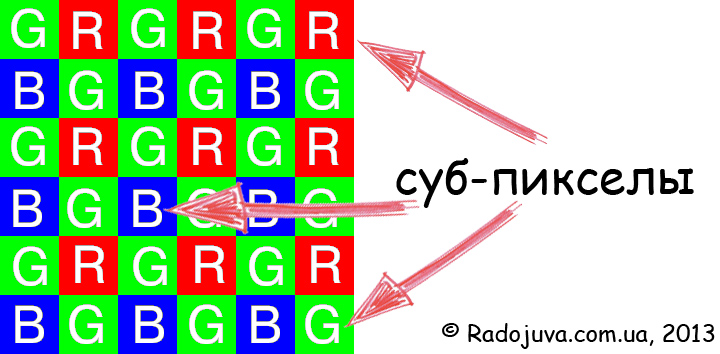

Píxel 'no real'

De hecho, esta matriz no consiste en píxeles ('en el sentido habitual'), sino en subpíxeles o celdas registradoras. En general implicarque un píxel es un punto en una imagen que representa cualquier color. En un sensor CMOS Nikon D700 solo hay subpíxeles, que son responsables solo de los tres tonos principales, sobre la base de los cuales se forman los píxeles 'reales', 'multicolores'. La Nikon D700 tiene alrededor de 12 870 000 de estos subpíxeles, denominados píxeles "efectivos" en el manual.

No hay 12 MP 'reales' en el sensor Nikon D700. ¡Y los 12 MP que vemos en la imagen final son el resultado de una dura interpolación matemática de 12.87 Mega subpíxeles!

Cuando se promedia, cada subpíxel se convierte en un 'píxel' real mediante algoritmos. Esto sucede debido a los píxeles vecinos. Aquí solo está escondido'magia callejera de píxeles'. Del mismo modo, 4 mil millones de colores también es obra del algoritmo de desbayerización.

La idea principal del artículo: subpíxeles y píxeles. Se nos venden 12 millones de subpíxeles por el precio de 12 millones de 'píxeles reales'.

Hablando muy groseramente, los especialistas en marketing llamaron 'píxeles' a los subpíxeles del filtro de Bayer y, por lo tanto, sustituyeron los significados de las palabras. Todo está ligado a lo que necesita entender exactamente por la palabra 'píxel'.

Volvamos a los cálculos del volumen de archivos. De hecho, el archivo NEF solo almacena 14 bits de información para cada subpíxel del filtro Bayer, que en realidad tiene la misma profundidad de tono. Teniendo en cuenta que hay 12 de estos subpíxeles en la matriz (el número es aproximado, se indica en las instrucciones), entonces el almacenamiento de la información obtenida de ellos requerirá:

12 * 870 bits = 000 bits o 14 MB

Y, sin embargo, no obtuve los 24,4 MB que observo en mi computadora de ninguna manera. Pero si sumamos datos de EXIF y JPEG PreviewImage, puede obtener los 24,4 MB iniciales. Resulta que el archivo RAW también almacena:

24,4-21,48 = 2,92 MB de datos adicionales

Importante: se pueden hacer cálculos similares para cámaras que usan sensores CCD y archivos RAW sin compresión: Nikon D1, D1h, D1x, D100, D200, así como matrices JFET (LBCAST) - nikon d2h, D2hs. De hecho, no hay diferencia ¿Es CCD o CMOS? – todavía usan el filtro Bayer y los subpexilos para formar la imagen.

Pero las cámaras Sigma con matrices Foveon tienen un tamaño de archivo RAW mucho mayor para los mismos 12 MP en comparación con una matriz CMOS que codifica un píxel real usando tres píxeles de colores primarios (como se esperaba), esto solo confirma mi razonamiento. Por cierto, apareció otro en Radozhiv. artículo interesante и uno mas.

Hallazgos

De hecho, las cámaras que usan matrices de filtro Bayer (CCD, CMOS, no importa) no tiene el número real declarado de píxeles 'reales'. en la matriz solo hay un conjunto de subpíxeles (elementos fotográficos) del patrón de Bayer, a partir del cual, utilizando algoritmos complejos especiales, se crean píxeles de imagen 'reales'. En general, la cámara no ve una imagen en color en absoluto, el procesador de la cámara trata solo con números abstractos que son responsables de un tono particular de rojo, azul o verde, y crear una imagen en color es son solo trucos matematicos. En realidad, esta es la razón por la que es tan difícil lograr la reproducción de color 'correcta' en muchas CZK.

Materiales relacionados

- Sistemas sin espejo de fotograma completo. Discusión, elección, recomendaciones.

- Sistemas sin espejo recortados. Discusión, elección, recomendaciones.

- Sistemas sin espejo recortados que han detenido o están finalizando su desarrollo

- Sistemas de espejos digitales que han detenido o están finalizando su desarrollo

- JVI o EVI (un artículo importante que responde a la pregunta 'espejo o sin espejo')

- Acerca de las baterías sin espejo

- Formato medio simple y claro

- Soluciones especialmente rápidas de marcas chinas

- Todos los objetivos con zoom de enfoque automático más rápidos

- Todos los objetivos fijos de enfoque automático más rápidos

- Fotograma completo reflejado en formato medio sin espejo

- Impulsores de velocidad de enfoque automático

- Una lente para gobernar el mundo

- El impacto de los smartphones en el mercado de la fotografía

- ¿Qué sigue (supremacía de los teléfonos inteligentes)?

- Todos los anuncios y novedades de objetivos y cámaras

Los comentarios en esta publicación no requieren registro. Cualquiera puede dejar un comentario. Muchos equipos fotográficos diferentes se pueden encontrar en AliExpress.

Material preparado Arkadi Shapoval. Formación/Consultas | YouTube | Facebook | Instagram | Twitter | Telegram

RAV es la caja de Pandora, y nadie sabe qué hay dentro. solo se sabe una cosa, todo esto es interpolacion

Bueno, al menos los fabricantes de Capture One, Lightroom (sin formato de cámara) y montones de convertidores de código abierto tienen una idea al respecto.

La Nikon D700 tiene alrededor de 12 870 000 de estos subpíxeles, denominados píxeles "efectivos" en el manual.

12.87 total, 12.1 efectivo, 12.87 subpíxeles, 12.1 píxeles.

Gracias por la revisión, muy emocionante e interesante :) (Me gusta)

Sería interesante que escribieras estas preguntas a la oficina de representación oficial de Nikon... Arkady, ¿no lo pensaste?

Con CCD, según tengo entendido, ¿las cosas son similares?

Sí, no importa CCD o CMOS, siempre que haya un filtro Bayer, entonces se consideran todos los píxeles.

"Pero las cámaras Sigma con matrices Foveon tienen un tamaño de archivo RAW mucho más grande para los mismos 12 MP en comparación con una matriz CMOS". No sé por qué más, pero la esencia es la misma. Decidieron que, dado que todos los fabricantes mienten, estamos peor, por lo que en realidad llaman a sus matrices de 4 megapíxeles 12 megapíxeles (dado que hay tres subpíxeles a diferentes profundidades en un píxel, entonces el marketing no debe permanecer en silencio).

El punto no es exactamente el mismo. Hay 3 capas, en cada capa solo ciertos subpíxeles (capa azul, capa verde, capa roja). El número de píxeles para dichas matrices se escribe (por ejemplo, para Sigma SD1) 15,36 millones (4800 × 3200) × 3 capas. Esos. realmente hay un total de 15.36 millones de PIXELES. Y la imagen allí es mucho más nítida.

Para tener la misma resolución en una matriz CMOS, esta última debe tener:

15.36 * 3 * 0.75 = 34.56 M SUBpíxeles

0.75 - factor de conversión - 3 subpíxeles en Foveon frente a 4 en CMOS

Sí, es lo mismo. “Al igual que los fabricantes de fotosensores Bayer, que indican el número de subpíxeles de un solo color en las características de las matrices, Foveon posiciona la matriz X3-14.1MP como de “14 megapíxeles” (4,68 millones de “columnas” de tres sensores). Este enfoque de marketing, cuando se denomina “píxel” a un elemento que percibe un color, actualmente es generalmente aceptado en la industria fotográfica”.

Por cierto, ¿alguien sabe qué estructura de filtro Bayer tiene la Nikon D1X con su maravillosa matriz?

Exactamente lo mismo, RGGB, solo que los píxeles no son cuadrados, sino rectangulares (alargados en altura).

Hay un excelente programa RawDigger (http://www.rawdigger.ru/), Realmente no lo descubrí, pero es algo muy útil para recoger cuervos, con su ayuda puedes entender qué tipo de cerdo plantó el fabricante)))

Bueno, el sitio de una persona maravillosa Alexei Tutubalin (http://blog.lexa.ru/) muchas cosas interesantes sobre escoger en partes iguales

artículo extremadamente inusual e interesante ... ¡gracias!

¡Qué giro! En mi ingenuidad, pensé que si un píxel se compone de tres celdas de color, entonces estas celdas deberían ser de 12M por 36MP...

Aunque hay otro punto interesante. De hecho, cuando se ve en un monitor LCD, cada píxel también consta de 3 celdas. Pero al mismo tiempo, el número real de píxeles de longitud / altura está escrito en el monitor, y no el número de celdas. Los que son inteligentes aquí son solo fabricantes de cámaras.

Cuando ve una imagen de un monitor de TV, percibe tres subpíxeles de tres colores como un píxel de algún otro color. Hay tres rectángulos, generalmente con una altura igual a un píxel cuadrado y un ancho de un tercio de este cuadrado; si los pones uno al lado del otro, solo obtienes un cuadrado.

En la cámara, la matriz consta de una serie de fotosensores que no registran el COLOR, sino la intensidad de la luz. Delante de cada fotosensor hay un cristal translúcido: rojo, verde o azul. El vidrio transmite solo 1/3 (aproximadamente) del espectro visible. Si se eliminan estos filtros, obtenemos una imagen en blanco y negro limpia. Si los filtros están configurados, obtenemos tres conjuntos de imágenes en blanco y negro, similares a los canales en Photoshop. Solo que seguirán siendo granulados por encima de todo debido a la peculiar disposición de los elementos en la matriz.

La cámara estira la imagen de cada canal, inserta los píxeles que faltan y ensambla la imagen RGB a partir de ellos, que nos muestra el monitor. Todos los convertidores sin procesar hacen lo mismo en lugar de una cámara, a veces mejor a expensas de una mayor potencia de procesamiento.

un poco mal Hay monitores con cuatro píxeles RGBW. En AMOLED, generalmente hay una imagen terrible del tipo de comprador.

Tengo una Canon 50d con 15mp y archivos RAW que van desde 13mb a 27mb.

Hmm... tengo una canon 550d y también diferentes tamaños RAW, y difieren mucho, de alguna manera no encaja con el artículo...

Esto se debe a que la 550D usa RAW con compresión, en la D700 puedes obtener archivos RAW de 10 a 25 MB de la misma manera, para esto se describe aquí https://radojuva.com.ua/2012/08/12-bit-raw-vs-14-bit-raw/. Por lo tanto, en este artículo, me enfoco en el hecho de que usé la configuración "sin compresión" en el menú de la cámara.

¿Qué pasa con mi 50d entonces? En él, siempre disparo en RAW y sin compresión: 14 bits.

¿Qué debería estar mal con él?

Bueno, me pregunto por qué todos los archivos son de diferentes tamaños, pero según entiendo, todos los archivos son casi del mismo tamaño.

La Canon 50d usa RAW comprimido de forma predeterminada, el tamaño del archivo de salida es diferente para cada toma individual. Si coloca "con compresión" en el d700 de este artículo, los archivos también tendrán un tamaño diferente. Lo mismo se aplica a los modelos inferiores de Nikon y Canon, donde no puede configurar RAW sin compresión. Esta bagatela distingue a las cámaras profesionales de las amateur.

Esto es lo que busqué en Google

Los archivos RAW de cámara digital suelen contener:

-valores de voltaje discretos de los elementos de la matriz (antes de la interpolación para matrices usando matrices de filtros de color)

-metadatos - identificación de la cámara;

- metadatos: una descripción técnica de las condiciones de disparo;

-metadatos: parámetros de procesamiento predeterminados;

- una o más variantes de la representación gráfica estándar ("vista previa", generalmente JPEG de calidad media), procesada por defecto.

A menudo, un archivo Raw también contiene una vista previa jpeg bastante grande, lo que aumenta el tamaño del archivo.

Historia: Wikipedia

http://ru.wikipedia.org/wiki/Raw_(формат_фотографий)

Arkady, empezaste tan bien y terminaste tan mal.

“Dado que hay 12 de esos subpíxeles en la matriz, entonces el almacenamiento de la información obtenida de ellos requerirá:

12 * 052 bits = 992 bits o 14 bytes o 168741888 MB”

Escribiste que hay 12 subpíxeles, fotosensores reales.

Por lo tanto:

12 * 870 bits = 000 bits = 14 MB. Este es el primero.

Segundo. En lugar de 14 bits, almacenar 2 bytes (16 bits) es un lujo que nadie necesita. En cada cuatro subpíxeles, ya hay dos verdes, es decir. 28 bits es la mitad del tamaño de un píxel cuádruple.

Esto es en gráficos por computadora, cuando se usa una representación de color de 16 bits, 16 por 3 no es divisible uniformemente (3 componentes de color), el último bit 16 se usa para el verde debido a la mayor sensibilidad del ojo a este color.

Entonces (24.44-21.48) MB se usa para almacenar lo que enumeró (incluido lo que se describe en Wikipedia).

En el último cálculo, al principio realmente tenía 12, pero realmente no puedo verificar cuántos de ellos, porque todavía usé solo los valores que puedo ver en mi computadora. La esencia de esto no cambia mucho.

En cualquier caso, el 12 052 992 es un número virtual y se obtiene solo después de debair, y en RAW todavía no hay debair.

Devolví el artículo a su forma original, mira, ¿está mejor?

Si. Y es bueno que eliminaron la declaración de que las "coordenadas" de los subpíxeles deben almacenarse en RAW. De hecho, para comprender qué subpíxel está codificado en un lugar determinado de información binaria, basta con saber el orden en que siguen, el ancho de la matriz de Bayer y la altura. En un ciclo de lectura de bits, esto es tan fácil como desgranar peras.

Artículo super!

¡Arkady! Del mismo modo, los especialistas en marketing están haciendo trampa con las pantallas LCD de las cámaras. Por ejemplo, para mi D7000, se indica que la pantalla tiene 921600 píxeles, parecería que es una resolución grande, pero en realidad, la pantalla tiene una resolución VGA normal (640x480), y una cantidad tan grande de píxeles es obtenido por la fórmula 640x480x3, donde 3 es el número de subpíxeles de color

y también los subpíxeles en sí mismos no ocupan toda el área de la matriz, es solo esquemáticamente que son tan 'gordos' :)

¡Está usted equivocado! ¡La resolución de la pantalla es correcta! 921600 puntos! 1176 × 784px

En el libro de Tom Hogan, reconocido experto en dispositivos Nikon "Guía completa de la Nikon D7000" en las páginas 236-237, se indica que la pantalla tiene una resolución de VGA 640 × 480 píxeles, y para ser más precisos, un matriz de puntos 1920 × 480

buenas noches. Arkady, nunca he tenido una cámara profesional. Pregunta: - ¿Qué realmente 14 bits de color transmiten la imagen con mucha más precisión que 12?

14 bits son más adecuados para un procesamiento posterior, y las imágenes en el monitor no se distinguen entre sí. No solo las cámaras profesionales tienen 14 bits, por ejemplo, D5100, D5200 también usan profundidad de color de 14 bits, pero solo con compresión, más detalles aquí https://radojuva.com.ua/2012/08/12-bit-raw-vs-14-bit-raw/

Arkady, ¡gracias por el artículo!

Todo parece estar bien, pero en mi opinión, algo no cuadra...

si la D700 tiene 12 píxeles MegaSUB, ¿de qué manera milagrosa se forma la imagen en la pantalla con una resolución de 4256 por 2832? si 12 fuera el número de megasubpíxeles, ¡entonces la resolución final tendría que ser diferente!

¡Después de todo, cada punto de estos 4256 por 2832 está formado por 3 (4) subpíxeles!

Si me equivoco, por favor corrígeme.

En realidad, este es el algoritmo de eliminación, cuando un píxel monocromático se colorea al leer la información de los píxeles vecinos. En el artículo, mencioné más de una vez que el algoritmo de los subpíxeles hace píxeles, inflándonos así de alguna manera.

En la D5100, puede deshabilitar la compresión de archivos RAW usando firmware dañado. lo tengo deshabilitado Los archivos se obtienen en promedio en 32 KB. :)

En cuanto a 14 y 12 bits, el artículo:

"Los últimos 2 bits, ¿por qué?"

http://www.libraw.su/articles/last-2-bits.html

Por lo tanto, la matriz Super CCD produce un color mucho mejor que el CMOS estándar.

y la vieja Kodak proporciona mejores colores que cualquier Nikon.

Hay uno :)

Arkady, gracias por tu trabajo, no me pierdo ni un solo artículo tuyo, aprendí muchas cosas útiles, una vez más, ¡muchas gracias!

Hola. Yo también estaba interesado en este tema, y esto es lo que descubrí.

En primer lugar, según el algoritmo de desbayerización. En esencia, es bastante simple: se toma un cuadrado de subpíxeles de 2x2 de la matriz, uno rojo, uno azul y dos verdes caen en él. En base a esto, se calcula el color del píxel. Luego, el cuadrado se desplaza hacia la derecha un subpíxel y RGGB ingresa nuevamente. Por lo tanto, el cuadrado "recorre" toda la matriz y la salida es una imagen de casi la misma resolución que la matriz de subpíxeles. Esto es simplemente simplificado, en realidad es un poco más complicado, y cada empresa tiene su propio conocimiento sobre cómo evitar la distorsión cromática, el desenfoque, etc. durante el proceso de desbayerización.

¿A dónde van los píxeles ineficientes? Un poco sobre esto se describe en dpreview: http://www.dpreview.com/glossary/camera-system/effective-pixels . En breve:

1. Parte de los píxeles se pierde debido a la desbayerización: un píxel en cada lado. Pruébelo usted mismo, por ejemplo, en un cuadrado de 4x4 (16 subpíxeles) solo hay 9 cuadrados de 2x2 (píxeles recibidos)

2. Parte de los píxeles no está expuesto a la luz y se utilizan para obtener datos sobre el comportamiento del sensor en la parte no iluminada de la matriz: iluminación de sombra, tal vez el nivel de ruido, alguna otra información.

3. Y algunos de los sensores desaparecen debido a las características de diseño; es solo que la matriz resulta ser demasiado grande para este modelo de cámara y parte del área no se usa. Y hacer una matriz separada del tamaño correcto personalmente para esta cámara es costoso.

Y, en general, si busca las frases "píxeles ineficientes", "dónde van los píxeles ineficientes", entonces Google / Yandex encontrará mucho más que buscar "efectivo" :)

También calculó mal el tamaño final del archivo. Sí, RAW almacena absolutamente toda la información de la matriz y en la forma más cruda. El procesador de la cámara lee datos de 14 bits de la matriz en una celda de memoria de 2 bytes y los escribe en un archivo de esta forma. Lo más probable es que sea lineal, tal como se lee, sin ningún formato de archivo especial. Por lo tanto, cada subpíxel no ocupa 14 bits de datos, sino los 16, y el tamaño total del archivo es 12 870 000 x 2 = 25 740 000 bytes, o 24,54 megabytes. Agregue metadatos aquí (condiciones de disparo, configuración de la cámara, modelo de cámara, versión de firmware), además de una imagen de vista previa, obtendrá solo su 25,5.

Dos bytes no ruedan. Usted indicó que de esta manera obtiene 24,54, y esto ya es más que mi archivo de 24,4 MB. ¿Dónde más agregar metadatos?

Sí, lo siento, realmente me lo perdí. Resultó que, incluso dentro de la misma empresa, los datos pueden empaquetarse en paquetes, luego cada subpíxel realmente ocupará solo su propio volumen, o almacenarse por separado, luego se expanden a dos bytes.

“En primer lugar, según el algoritmo de desbayerización. En esencia, es bastante simple: se toma un cuadrado de subpíxeles de 2x2 de la matriz, uno rojo, uno azul y dos verdes caen en él”.

Realmente no. Más precisamente, en absoluto :) El procesamiento se lleva a cabo para cada plano por separado, para rojo, azul y verde. Al mismo tiempo, el verde tiene el doble de resolución. La tarea es restaurar tres píxeles para cada bloque rojo y azul y dos píxeles para el bloque verde.

Los algoritmos utilizados en este caso son muy diferentes y, a menudo, bastante complejos. Partiendo de que la interpolación se realiza sobre bloques de mayor tamaño (5x5, 7x7 píxeles, no un cuadrado de 2x2) y terminando con cálculos basados en el componente de brillo obtenido a partir de píxeles de todos los colores.

Ustedes ahora recuerdan mucho a una multitud de intérpretes talmúdicos nerviosos que discuten sobre el significado de la ubicación de una letra antigua en el medio de una palabra de una frase de algún sabio sobre algún tema, supuestamente al reorganizarla a otro lugar, completamente cambia el significado de la expresión y los acentos... Tal vez algunos de ustedes no necesitan hacer fotografía en absoluto, ¿eh? Bueno, hay pilotos de carreras, y hay reparadores de coches, costureras y fabricantes de agujas de coser...

Compañero, ¿por qué no ilustrarse en términos técnicos y de ingeniería, eso es malo?

Es impensable que un piloto de carreras profesional no entienda lo que conduce y cómo funciona su aparato.

Ahora las cámaras están hechas por ingenieros con vendedores, y no por artistas y fotógrafos.

¿Debemos admitir que se forma un rostro milagroso en una caja maravillosa por mandato de nuestro Señor Jesucristo? ¿Y espiritualizados por este mensaje para continuar con su ocupación, sin oscurecer la mente pobre con fabricaciones prohibidas?

¡Dijiste tonterías! Eres una persona valiente: No todo el mundo puede “dejar caer” fácilmente las tonterías y no avergonzarse en absoluto por ellas. ¡Bravo!

¡Al exorcista, urgente!

Eso es exactamente lo que es :) Tratar de hacer fotografía y, en general, ni siquiera recordar la configuración de la luz y la iluminación para disparar es completamente estúpido: si no "ve" qué fotografiar, no hay necesidad de hablar sobre la herramienta en todo - "cámara y lente". Entre los miles de comentarios sobre el proyecto, solo hay algunos con preguntas "sobre la luz" y ninguna respuesta sensata.

No entendí nada.

“Pero, ¿qué son estos 'píxeles efectivos', de los que hay casi un millón (1 MP) más (12,87 MP)?”.

¿Quizás se quiso decir el número total de píxeles y no efectivo en esta propuesta?

Gracias por el artículo. Hizo un punto importante. La desbayerización es esencialmente interpolación. Y la interpolación no hace milagros, no se saca nueva información de ningún lado. Esos. de hecho, podemos volver a reducir una foto jpg, bmp (no sin formato) en 2 veces en ancho y largo, y por lo tanto reducir los archivos de fotos en aproximadamente 4 veces, mientras que contendrá la misma cantidad de información que el original.

Esos. todas estas introducciones por parte de los vendedores, además de los números inflados, llevan a inflar artificialmente el tamaño del archivo y, como resultado, al costo de nuevos discos duros, unidades flash, tarjetas de memoria, computadoras nuevas (los archivos grandes son más difíciles de procesar ), el tráfico en Internet, etc. Si fuera mi voluntad, haría estos vendedores.... .

La desbayerización y la interpolación no son lo mismo. Sí, hay menos información de color que en el archivo final, pero todos los píxeles aún recopilan información de luminancia. Los fabricantes utilizan algoritmos de recuperación que son más complicados que el “aumento 2x”, por lo que no es tan fácil decir que 4 píxeles forman uno final, todo es mucho más complicado. Habiendo reducido, como usted dice, la imagen en 2 veces, no restaurará por interpolación lo que produjo la cámara después de la desbayerización. Sí, la nitidez en la imagen reducida será mayor, pero eso no quiere decir que lo hayamos conseguido sin pérdida de información.

Por el hecho de que la desbayerización no es lo mismo que la interpolación. Digamos que la matriz fotik contiene 10 * 10 celdas, esto es 100 bytes de información. Hacen una foto RGB con ella, que ya contiene 10 * 10 * 3 = 300 bytes de información. ¿De dónde obtuvo la desbayerización 200 bytes de nueva información sobre el tema? Ella lo interpoló a partir de los 100 bytes originales, solo que está ingeniosamente velado. Estos 200 bytes no pueden contener ninguna información nueva sobre el objeto que se captura.

Intente comprimir cualquier foto 2 veces y luego restaurar su tamaño original, por ejemplo, con interpolación bilineal (xnview puede hacer esto). ¿Ves una gran diferencia entre el original y este?

Para empezar, estudie, al menos aproximadamente, los algoritmos de desbayerización y luego hable sobre el hecho de que la cámara generó 200 bytes de información. Ella no inventó estos 200 bytes, sino que los calculó y restauró en función de los datos de todos los píxeles. Si la cámara hiciera desbayerización. reducir la resolución resultaría en cierta pérdida de detalle.

Si reduzco la foto 2 veces y luego la aumento, habrá una diferencia. Y cuanto mejor sea la cámara y la óptica, mayor será la diferencia (por supuesto, un marco de 16 megapíxeles de una jabonera será indistinguible incluso cuando se redimensiona 4 veces, pero no estamos hablando de eso).

Además, no se olvide del ruido y del mismo JPEG, en el que se disparan todas las jaboneras y muchas SLR: allí, comprimir una imagen de una resolución más baja conducirá a una mayor pérdida de detalles, puede verificarlo guardando un 2 -doblar la imagen en JPEG y luego volver a aumentarla.

>> Ella no inventó estos 200 bytes, sino que los calculó y restauró en función de los datos de todos los píxeles.

Esto es lo que es la interpolación. Puedo tomar cualquier foto y no inventarla, sino calcular y restaurar cualquier número de píxeles por interpolación bilineal. El único sentido de estos píxeles es 0. Sabemos sobre el objeto solo 100 bytes, y los 200 restantes son nuestras conjeturas extraídas del dedo.

>>Si la cámara hiciera la desbayerización reduciendo la resolución, esto conduciría a cierta pérdida de detalles.

Luego, en lugar de 10 * 10, obtienes 5 * 5 * 3 = 75 bytes, es decir Se perderían 25 bytes. Esos. 2 canales de verde se promediarían en uno, la pérdida es pequeña. Por supuesto, es mejor para un vendedor inflar el tamaño a 300 bytes.

Es posible traducir honestamente una matriz de celdas 10*10 en una foto 10*10*3, de modo que cada píxel sea del mismo color que la celda, es decir en cada píxel, solo se encendería el subpíxel rojo, solo verde o solo azul, y los otros 2 estarían apagados. Tal foto, aunque ocupa 300 bytes, almacena solo 100, los 200 restantes son ceros vacíos. Pero esta es una traducción honesta. Luego haz lo que quieras con él, al menos desbayerización, al menos interpolación. Pero luego el engaño será muy obvio, amplié la foto y allí cada píxel es solo un tono. Por lo tanto, los fabricantes en realidad desenfocan un poco esa foto, y cada píxel se promedia con su vecino, y lo llaman desbayerización, aunque esto ni siquiera es interpolación, sino un desenfoque estúpido. Ahora vemos píxeles de todos los tonos y el engaño no se nota. Así como en la foto había 100 bytes de información útil, los 200 restantes son basura.

Sí, ya te están explicando lo mismo varias personas, y estás por tu cuenta, basura y todo :)

O aprende cómo funciona realmente la desbayerización, o cambia el tamaño de tus fotos 4x y sigue pensando que no tienes nada que perder. Puedo aconsejarle que compre un teléfono Nokia 808 PureView, hay justo lo que le conviene: una matriz de 41 megapíxeles, pero el énfasis no está en la resolución, sino en la alta calidad de las imágenes de 8 megapíxeles mediante la combinación de píxeles adyacentes. Ahí es donde estarán los megapíxeles más honestos para ti :)

inunde al fabricante con reclamos de falsificación) ni un solo juez cortará el tema ... y el artículo es fuerte, te hace pensar.

¿Y dónde, exactamente, la falsificación? :)

En la cámara están escritos 12 megapíxeles, también hay alrededor de 12 millones de celdas sensibles a la luz, la imagen también contiene 12 millones de puntos, todo corresponde al declarado.

todo es muy interesante e informativo, muchas gracias al autor por su trabajo, y que todo en su vida sea bueno